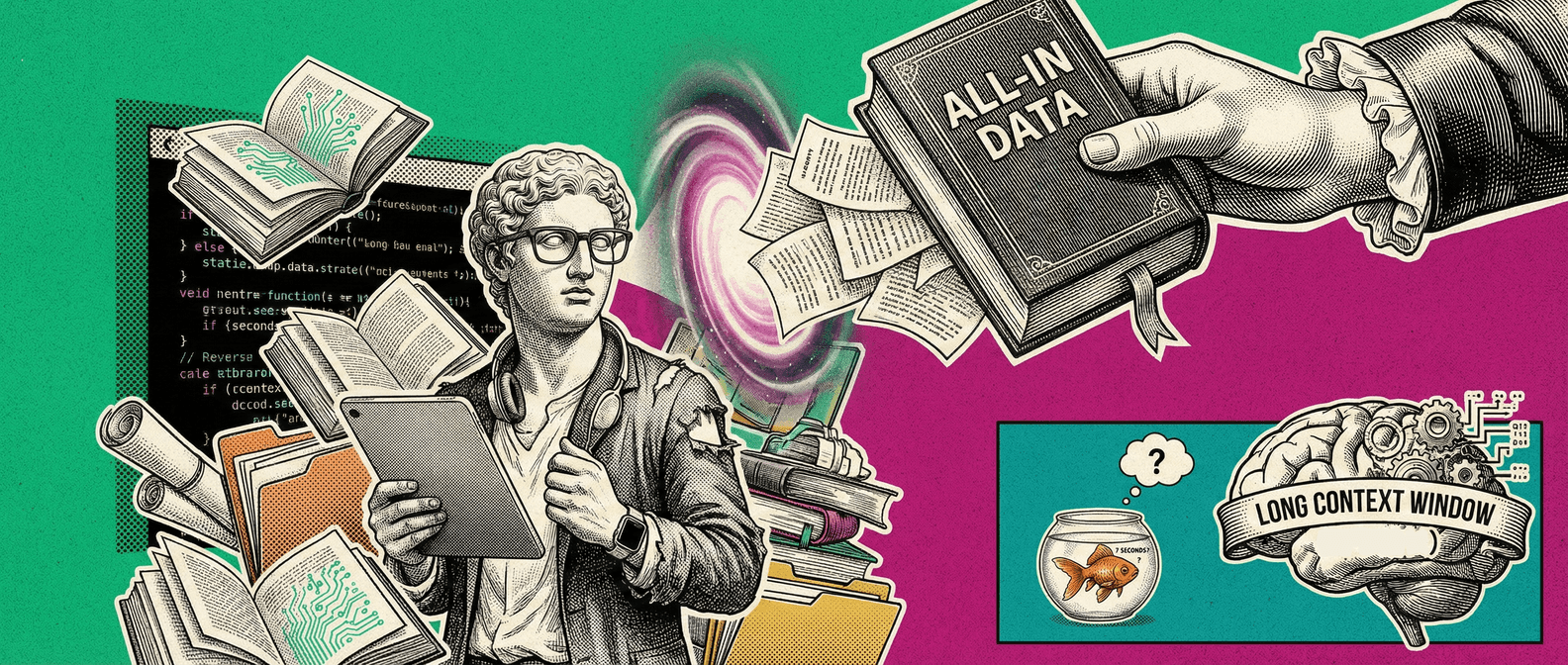

大还是小?它不是金鱼,它是图书馆长

Written By

语嫣大厂产品经理,爱红装。

Published:

很多人用 AI 的时候,特别小心翼翼。 发个长文档,还得先裁成好几段,一段段发: “这是第一部分,请记住,不要回复。” “这是第二部分……”

我就纳了闷了,你这是在喂猫呢?还怕它噎着?

这其实是很多人的刻板印象:认为 AI 记性不好,说多了就忘。 没错,在两年前,AI 确实是条金鱼。 它的记忆只有七秒(或者说几千个 Token)。 你讲到前门楼子,它已经忘了胯骨轴子。

但现在,时代变了。 现在的 AI(比如 Claude 3, DeepSeek R1),早就不是金鱼了。 它是过目不忘的图书馆长。

专业术语叫 Long Context Window(长上下文窗口)。 这是什么概念? 你可以把一整本《红楼梦》,或者你公司十年的财务报表,甚至整个项目的几十万行代码,一次性,全部,甩在它脸上。 它不仅接得住,而且读得懂。

你问它:“在第 38 回里,贾宝玉吃了什么?” 它能精准地从这几十万字里,把你想要的那句话挑出来,连标点符号都不差。

所以,别再把书撕碎了喂它了。 那样做,不仅累死你,而且效果极差。 因为破碎的信息,没有逻辑关联。AI 看不到全貌,就只能瞎猜。

正确姿势是什么? All-in。 把你的需求、背景、参考资料、过往案例、避坑指南……打包成一个巨大的文件,直接扔进对话框。 然后说一句:“基于以上所有材料,给我写个方案。”

那一刻,你会感觉到什么叫**“降维打击”**。 它不是在陪你过家家,它是在用整个图书馆的知识储备,为你服务。

下次,试着粗暴一点。 它的胃口,比你想象的大得多。