RAG 质量评估:快速入门

Written By

技能练习生

本教程将带你通过一个最典型的场景,快速上门如何评估并优化你的 RAG 系统。假设你已经有了一个基于私有文档的问答机器人,但它最近的回答有些差强人意。

前提条件

- 准备环境: 确保你可以访问你的 RAG 系统后端或其检索出的原始文档分块。

- API 密钥: 如果你需要自动生成测试题(推荐),请确保配置好了支持 LLM 的 API Key。

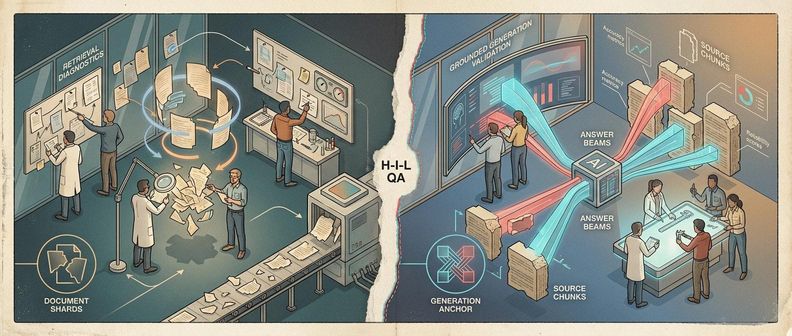

第一步:诊断——到底是哪里的错?

不要急着去调大模型参数,先看看它到底有没有“读对书”。

操作建议: 随机抽取 5-10 个回答错误的案例,查看检索出的前 5 个文档片段(Chunks)。

- 如果片段里根本没答案: 这是检索的锅,需要优化分块策略(Chunking)或向量索引。

- 如果片段里有答案但 AI 没答对: 这是生成的锅,需要优化提示词(Prompt)或增强模型理解力。

第二步:实战——生成你的第一批“考卷”

如果没有真实用户的提问,我们可以让 AI 帮我们出题。

指令: 你可以直接对这个 Skill 说(或在你的脚本中使用):

“为一个关于公司福利政策的文档分块,生成一对事实性的 QA 对,要求问题仅能由该分块回答。”

预期结果: 系统会产出如下 JSON 格式的考题:

{

"fact": "全勤奖为每月 500 元,需当月无迟到早退。",

"question": "公司每月的全勤奖金额是多少?领取条件是什么?"

}这一步的价值

通过这个简单的动作,你就拥有了第一个基准点(Baseline)。你可以用这个真实的“标准答案”去测试你的系统,看看它的 Recall@1(即第一条搜出来的结果是不是包含这个答案)是否达到 100%。如果这个都做不到,就需要去调整你的切片策略了。