RAG 质量评估:技能亮点

Written By

技能练习生

很多时候,你会发现斥资搭建的 AI 知识库机器人表现并不如意:要么搜不到关键文档,要么搜到了却在胡言乱语。这种“黑盒”状态最让人焦虑,因为你不知道该从哪里下手优化。

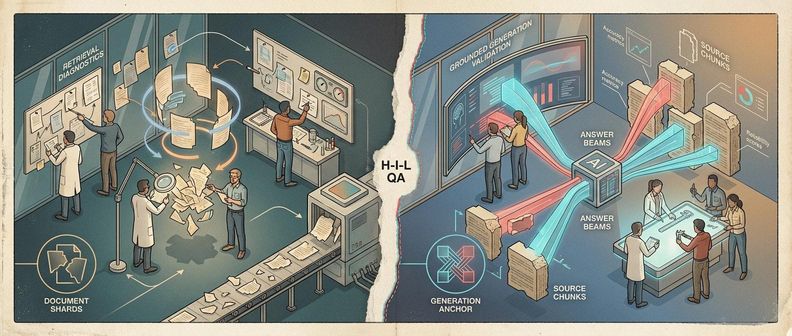

其实,要把 RAG(检索增强生成)系统做扎实,关键不在于堆模型,而在于一套科学的“体检”方法。RAG 质量评估 Skill 就是为了帮你拆解这个黑盒,通过量化指标告诉你检索准不准、回答真不真,让每一次参数调整都有据可依。如果你正在为 AI 产品的幻觉或召回率发愁,这个 Skill 会是你最得力的质检员。

为什么选择这个 Skill?

[让 RAG 优化从“全凭感觉”回归“量化评估”]

只有明确了是“没搜到”还是“没答好”,优化才有方向。本技能提供了一套完整的归因分析与评估框架,帮你精准定位性能瓶颈。

解决的核心痛点

分不清是检索还是生成的错

当 AI 回答错误时,你很难判断是它根本没找到相关文档,还是找到了却理解错了。本技能引导你进行端到端的错误分析,独立测量检索质量与生成质量,告别盲目调优。

缺乏高质量的测试数据集

手动编写大量的测试问题既耗时又枯燥。本技能利用 LLM 自动生成合成 QA 对,甚至能构建极具挑战性的“防御性问题”,快速帮你建立起一套覆盖面广、专业性强的检索评估库。

面对一堆技术指标无从选择

Recall@k、MRR、NDCG... 这么多术语到底该看哪个?本技能根据你的具体业务场景(如事实查询、知识总结)推荐最核心的评估指标,并教你如何通过网格搜索找到最佳的切片(Chunking)配置。